인공지능(AI)의 안전한 개발과 활용을 위해 교육분야 AI 관련 윤리원칙이 처음으로 마련됐다.

교육부는 11일, 교육분야 인공지능이 윤리적으로 개발되고 안전하게 활용될 수 있도록, 개발자와 교육당사자들이 함께 준수해야 할 '교육분야 인공지능 윤리원칙'을 확정·발표했다.

AI 윤리원칙은 지난 1월 27일 시안 발표 이후 공청회, 전문가 간담회, 국제 의견 조회 등 광범위한 의견 수렴을 거쳐 마련되었으며, 교육계와 관련 산업계가 준수해야 할 원칙과 실천과제를 담고 있다.

주요 7개국 정상회담(G7) 국가 및 국제연합 교육과학문화기구(유네스코) 등에 의견을 조회했으며(5~6월), 영국 교육부에서는 관심 표명 및 지지 의견 제출한 것으로 전해졌다.

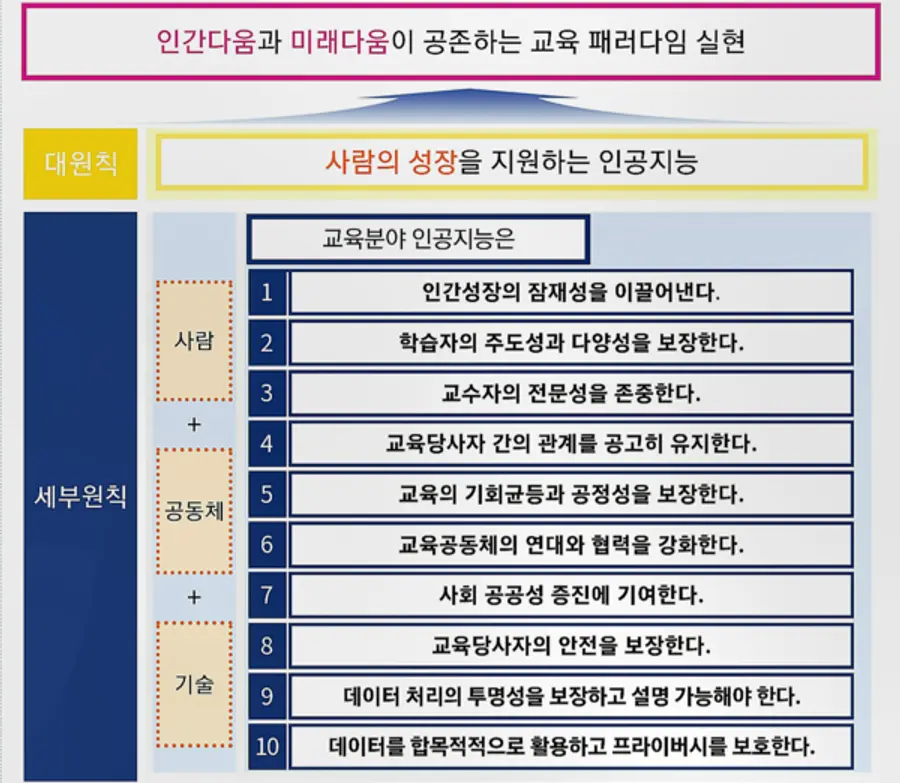

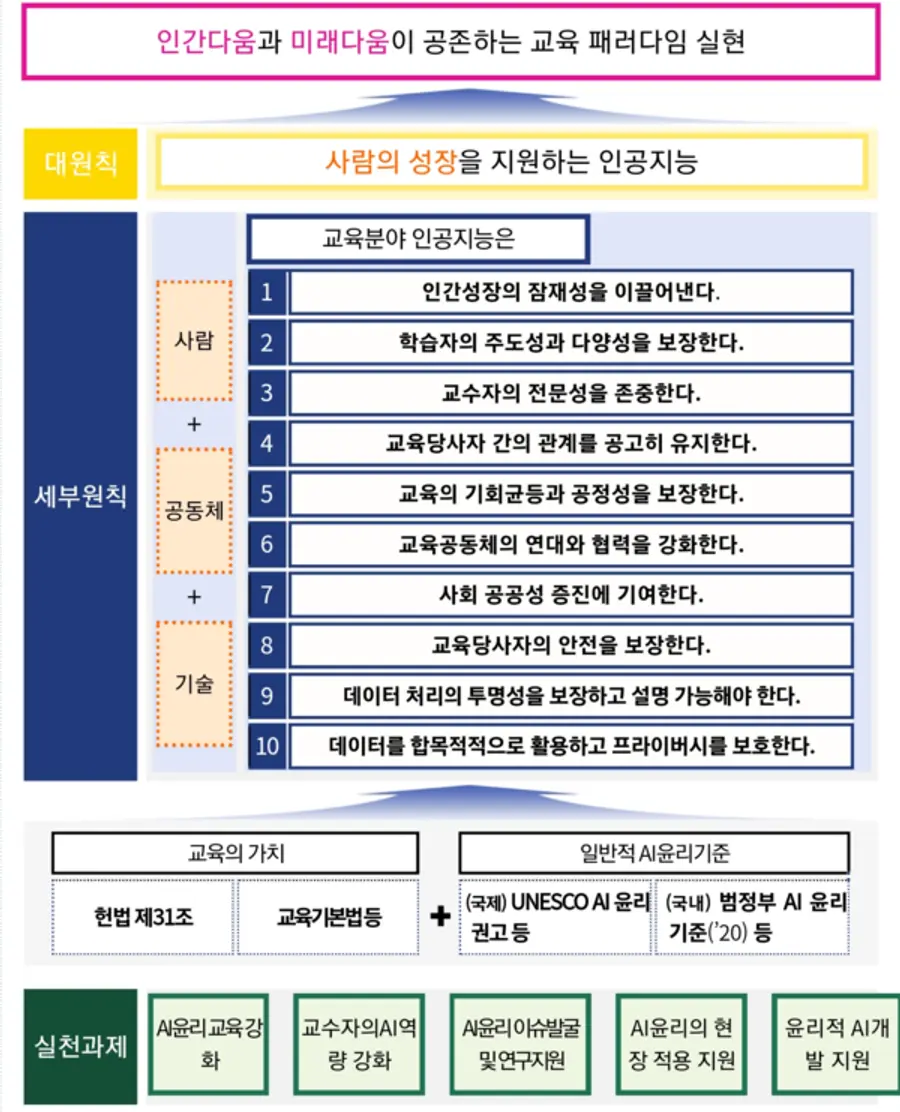

특히, ‘사람의 성장을 지원하는 AI’이라는 대원칙을 바탕으로 교육 분야에서의 인공지능 개발·활용 가이드라인을 최초로 제시했다는 점에서 그 의미가 남다르다고 교육부는 강조했다.

AI 분야는 기술 발전이 빠르게 이루어짐에 따라 예상치 못한 윤리적 이슈에 대응하기 위해, 전 세계적으로 사후적 규제보다 예방적·자율적 규범이 강조되고 있다.

우리나라도, 범정부 'AI 윤리기준'(2020.12.)에서 각 분야별 여건에 맞는 윤리기준 제정을 권고하고 있으며, 교육분야에서는 유네스코가 학습에 사용되는 인공지능의 엄격한 관리 필요성을 전 세계에 권고한 바 있다.(2021.11.)

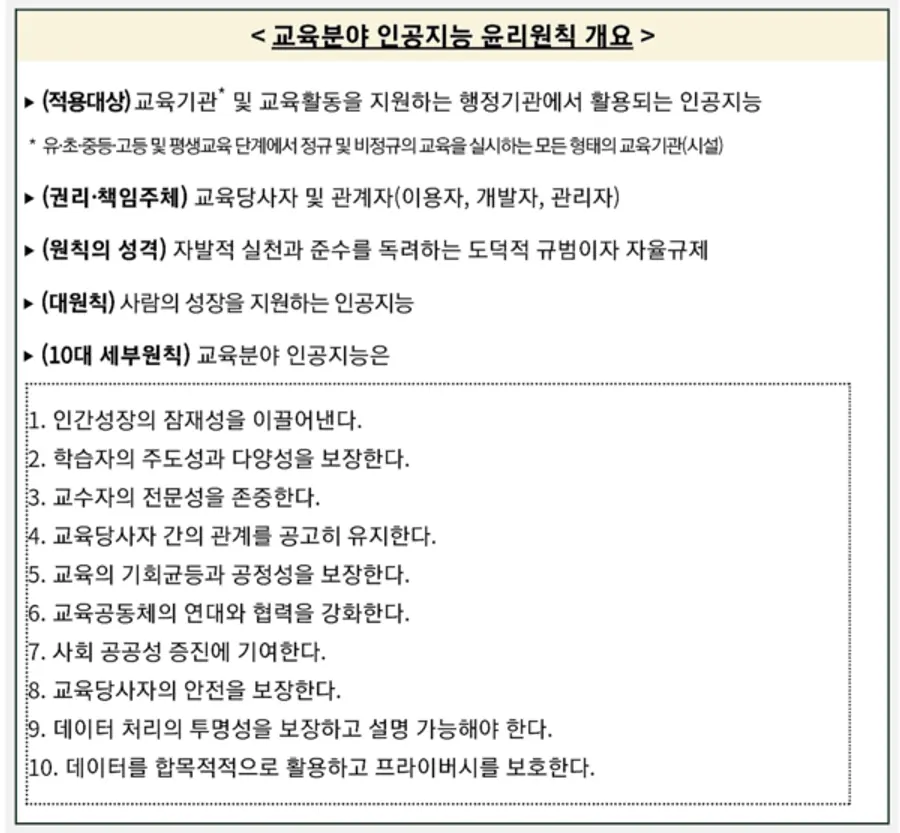

'교육분야 AI 윤리원칙'은 ‘사람의 성장을 지원하는 인공지능’을 대원칙으로 10대 세부원칙을 제시하고 있으며 주요 내용은 다음과 같다.

교육부는 윤리원칙을 AI 윤리교육과 교원의 역량 강화 연수 자료 등에 활용하고, 관련 연구의 촉진 및 에듀테크 기업과의 협업 가이드라인으로 활용하는 등 윤리원칙의 구체적 실천에도 만전을 기할 계획이다.

또한, AI 기술의 발전과 교육현장에서의 활용 실태 등을 고려하여 원칙의 타당성 검토 조치를 주기적으로 실시할 예정이다.

오석환 교육부 기획조정실장은 “AI가 미래세대의 인지·정서에 미치는 영향이 클 수 있는 만큼, 교육분야 AI의 개발과 안전한 활용이 균형을 이룰 수 있도록 교육계·산업계와 지속해서 소통하고 협력하겠다”고 밝혔다.

![[스페이스X IPO] ②몸값 2조 달러, 유동주식은 5% 안팎](https://cdn.www.smarttoday.co.kr/w400/q85/article-images/2026-05-26/46dc88c7-a1f7-4410-b199-cbf045a3c31b.jpg)

![[스페이스X IPO] ①초대형 IPO, 시장 돈은 받고 경영권은 지킨다](https://cdn.www.smarttoday.co.kr/w400/q85/article-images/2026-05-26/15ed7156-8775-4137-932a-ac221baec135.jpg)

댓글 (0)

댓글 작성

댓글을 작성하려면 로그인이 필요합니다.

로그인하기